OpenAI o3-mini

OpenAI hat mit o3-mini das neueste und kosteneffizienteste Modell seiner Reasoning-Serie vorgestellt. Dieses Modell ist sowohl in ChatGPT als auch über die OpenAI API verfügbar und wurde speziell für anspruchsvolle Aufgaben in Wissenschaft, Mathematik und Programmierung optimiert. Es kombiniert starke logische Fähigkeiten mit deutlich geringeren Kosten und reduzierter Latenz im Vergleich zu früheren Reasoning-Modellen wie o1-mini. [web:2][web:4]

Hauptmerkmale und Fähigkeiten

Kosteneffizientes logisches Denken

o3-mini wurde als das wirtschaftlichste Modell innerhalb der OpenAI-Reasoning-Serie konzipiert und bietet eine sehr gute Balance aus Leistung, Kosten und Geschwindigkeit. Im Vergleich zu älteren Reasoning-Modellen liefert es bei ähnlicher oder besserer Genauigkeit spürbar schnellere Antworten und benötigt weniger Rechenressourcen. [web:2][web:4]

Herausragende STEM-Fähigkeiten

Das Modell ist besonders leistungsfähig in den Bereichen Naturwissenschaften, Mathematik und Programmierung. In internen und externen Tests erreicht o3-mini mit mittlerem Denkaufwand eine Leistung auf dem Niveau von o1 bei anspruchsvollen Aufgaben und übertrifft o1-mini deutlich. Mit hohem Denkaufwand steigt die Genauigkeit speziell bei komplexen mathematischen und wissenschaftlichen Problemen weiter an. [web:2][web:5][web:14]

Optimiert für Entwickler

o3-mini unterstützt Funktionsaufrufe, strukturierte Ausgaben (z. B. JSON) und Entwicklernachrichten und ist damit eine produktionsreife Lösung für moderne Software- und Agentensysteme. Entwickler können o3-mini nahtlos in bestehende Workflows integrieren, etwa für komplexe Automatisierungen, Datenanalyse oder Coding-Assistenten. [web:2][web:4]

Flexible Denkleistung

Entwickler können zwischen niedrigem, mittlerem und hohem Denkeinsatz wählen, um das Modell an den jeweiligen Use Case anzupassen. Niedriger Aufwand eignet sich für schnelle Antworten mit geringer Latenz, während hoher Aufwand das Modell mehr „nachdenken“ lässt, um schwierige Aufgaben mit höherer Genauigkeit zu lösen. [web:2][web:4][web:6]

Integration in ChatGPT

Nutzer von ChatGPT können o3-mini über die Option „Reason“ im Nachrichteneditor testen oder eine Antwort mit aktiviertem Reasoning neu generieren. Verfügbar ist das Modell in erster Linie für Abonnenten wie Plus-, Team- und Pro-Nutzer; registrierte Benutzer können es in bestimmten Fällen über die Reason-Option ausprobieren. [web:2][web:6][web:14]

Erweiterte Suchfunktion

In ChatGPT kann o3-mini mit einer integrierten Websuche kombiniert werden, um auf aktuelle Informationen zuzugreifen. Antworten werden dabei häufig mit verlinkten Quellen angereichert, was Transparenz und Nachvollziehbarkeit der Ergebnisse verbessert. [web:2][web:6][web:12]

Leistung und Effizienz

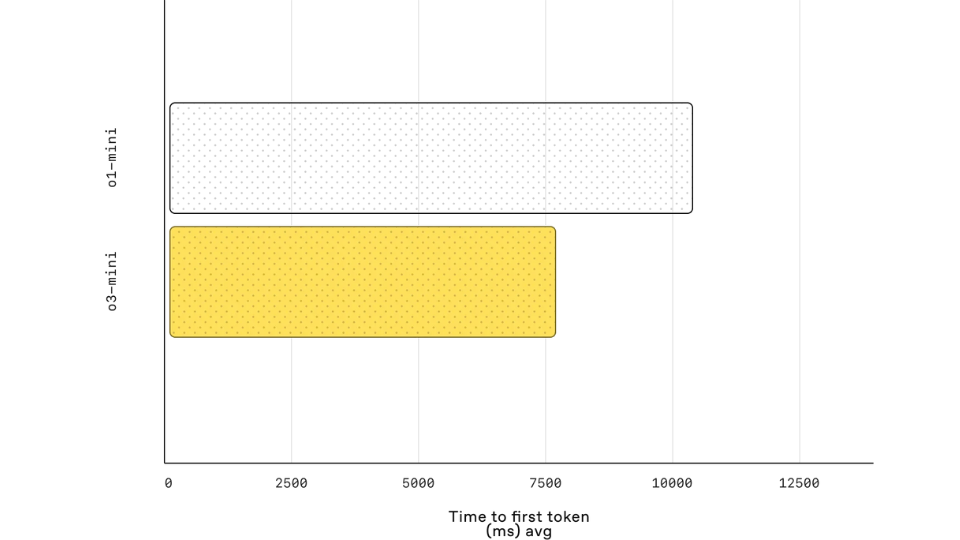

In OpenAI-internen A/B-Tests zeigt o3-mini deutlich schnellere Reaktionszeiten als o1-mini, bei gleichzeitig geringerer Fehlerquote in schwierigen realen Aufgaben. Testpersonen bevorzugten die Antworten von o3-mini gegenüber o1-mini in einem Großteil der Fälle, insbesondere bei komplexem logischem Denken. [web:2][web:4]

- Spürbar schnellere Antwortzeiten als o1-mini bei vergleichbarer oder besserer Qualität der Lösungen.

- Reduzierte Latenz bei interaktiven Anwendungen, insbesondere mit niedrigem oder mittlerem Denkeinsatz.

- Deutlich wirtschaftlicher als die größeren o3‑ und o4‑Reasoning-Modelle, bei sehr konkurrenzfähiger Leistung in STEM‑Szenarien. [web:2][web:3][web:4]

Diese Eigenschaften machen o3-mini zu einer leistungsfähigen, aber zugleich effizienten Lösung für rechenintensive Anwendungen wie Code-Assistenten, wissenschaftliche Workflows oder Datenanalyse-Pipelines. [web:2][web:4]

Wettbewerbsfähige Performance

o3-mini überzeugt in verschiedenen Benchmark-Tests und setzt neue Maßstäbe in Mathematik, Programmierung und Wissenschaft im Segment der kompakten Reasoning-Modelle. [web:2][web:14]

✅ Wettbewerbsmathematik (AIME 2024): [web:2][web:5]

- Mit mittlerem Aufwand erreicht o3-mini auf AIME‑ähnlichen Benchmarks ein Niveau vergleichbar mit o1. [web:2][web:5]

- Mit hohem Denkaufwand steigt die Genauigkeit deutlich an und übertrifft o1-mini und in vielen Fällen auch o1. [web:2][web:5][web:14]

✅ PhD-Level Wissenschaftsfragen (GPQA Diamond): [web:2][web:5][web:14]

- Mit hohem Aufwand erreicht o3-mini in GPQA‑Diamond‑Evaluierungen Ergebnisse auf o1‑Niveau oder darüber, insbesondere bei tiefer, mehrstufiger Argumentation. [web:2][web:5][web:14]

✅ FrontierMath: [web:2][web:14]

- Mit hohem Denkaufwand löst o3-mini einen signifikanten Anteil von Forschungs‑Level‑Mathematikaufgaben und übertrifft damit seinen Vorgänger auf diesem Benchmark. [web:2][web:14]

✅ Wettbewerbs-Codierung: [web:2][web:4][web:11]

- Mit zunehmendem Denkaufwand verbessert o3-mini seine Elo-Werte in Contest-Coding-Umgebungen deutlich und erreicht Werte, die typische GPT‑Modelle übertreffen. [web:2][web:5][web:11]

- Bei mittlerem Aufwand liegt die Performance im Bereich fortgeschrittener GPT‑Modelle, mit stärkerem Fokus auf verlässliches Schlussfolgern. [web:2][web:4]

✅ Software-Engineering (SWE-bench Verified): [web:2][web:11][web:14]

- o3-mini ist eines der stärksten OpenAI-Modelle auf SWE‑bench Verified und zeigt hohe Erfolgsraten bei realen Bugfix‑Aufgaben in großen Codebasen. [web:2][web:11][web:14]

✅ LiveBench Coding: [web:4][web:15]

- Auf LiveBench‑ähnlichen Codierungsaufgaben zeigt o3-mini bereits mit mittlerem Denkaufwand eine sehr starke Leistung und bleibt dabei reaktionsschnell. [web:4][web:15]