Was weißt du über Sora?

Sora ist ein von OpenAI entwickeltes KI-gestütztes Text‑zu‑Video-Modell, das aus einfachen Texteingaben realistische, kurze Videos erzeugen kann.[web:12] Anstatt klassische Video- oder 3D‑Software zu benötigen, beschreiben Nutzer die Szene in natürlicher Sprache – Sora erstellt daraus ein passendes Video mit konsistenter Bewegung, Licht und Perspektive.[web:3][web:9]

Sora wurde erstmals 2024 vorgestellt und im Dezember 2024 für ChatGPT‑Plus‑ und Pro‑Abonnenten in ausgewählten Ländern zugänglich gemacht.[web:3][web:9] Seitdem hat OpenAI das System mehrfach weiterentwickelt, unter anderem mit Sora Turbo und der zweiten Generation Sora 2, die bessere Physiksimulation und eine robustere Steuerung von Kamera, Stil und Szenenübergängen bietet.[web:2][web:6][web:10]

Die aktuelle Sora‑Generation kann Videos mit bis zu rund 20 Sekunden Länge in Full‑HD‑Auflösung (1080p) und verschiedenen Seitenverhältnissen (16:9, 9:16, 1:1) generieren, was sie sowohl für Social‑Media‑Clips als auch für professionelle Kurzvideos attraktiv macht.[web:7][web:10][web:13] In vielen Oberflächen lassen sich zudem bestehende Bilder animieren oder kurze Videos „remixen“, sodass Creator vorhandenes Material weiterverarbeiten können.[web:3][web:9]

Wie Sora funktioniert

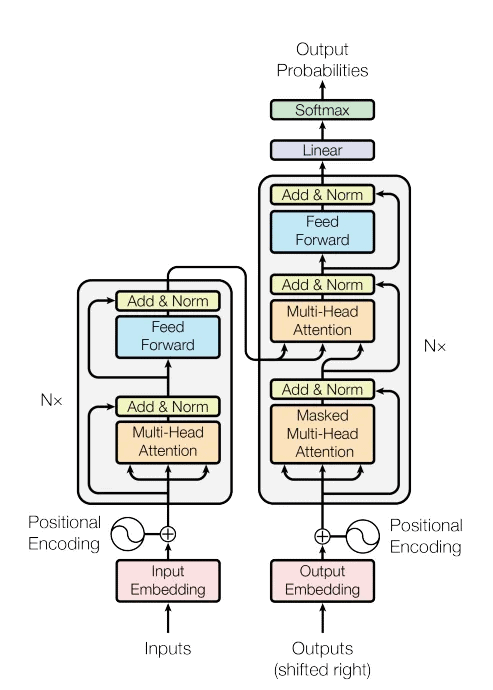

Sora gehört zur Klasse moderner Diffusionsmodelle, die ursprünglich aus der Bildgenerierung bekannt sind, wurde aber speziell für Video trainiert und mit einer Transformer‑Architektur kombiniert.[web:12] Vereinfacht gesagt lernt das Modell, aus verrauschten Eingaben Schritt für Schritt ein kohärentes Video zu rekonstruieren, das zur Textbeschreibung und zu den gelernten physikalischen Zusammenhängen passt.[web:3][web:12]

1. Diffusion und Rauschinjektion

Statt jeden Frame direkt zu zeichnen, startet Sora mit reinem Rauschen und entfernt dieses in vielen Iterationen, bis eine klare Videosequenz entsteht.[web:3][web:12] Dieser Diffusionsprozess ist mit Bildmodellen wie Stable Diffusion verwandt, aber auf zeitliche Konsistenz, Bewegungsabläufe und Kamerafahrten erweitert.[web:12]

2. Transformer‑Architektur

Sora nutzt eine Transformer‑Architektur, um räumliche Informationen innerhalb einzelner Frames und zeitliche Informationen zwischen den Frames gemeinsam zu verarbeiten.[web:3][web:12] So kann das Modell verfolgen, wie sich Objekte über die Zeit bewegen, miteinander interagieren und wie sich globale Eigenschaften wie Licht oder Wetter im Verlauf der Szene verändern.[web:2][web:11]

3. Verarbeitung der Texteingabe

Die Texteingabe wird in Token bzw. „Patches“ umgewandelt, die semantische Informationen wie Objekte, Stile, Kameraperspektiven und Bewegungsverläufe kodieren.[web:3][web:12] Diese Repräsentationen werden mit Video‑Patches verknüpft, sodass Sora nicht nur einzelne Begriffe, sondern ganze Szenenbeschreibungen versteht und visuell umsetzen kann.[web:3][web:10]

4. Vorhersage und Verfeinerung

Während des Generierungsprozesses sagt das neuronale Netz voraus, wie die Video‑Patches aussehen sollen, damit sie zur Textbeschreibung und zu vorherigen Frames passen.[web:3][web:10] Durch wiederholte Verfeinerung entstehen Szenen mit zunehmend höherer Detailtiefe, stabiler Bewegung und konsistenter Bildgestaltung.[web:2][web:10]

5. Training mit Text‑ und Videodaten

Sora wurde auf großen Datensätzen trainiert, die Video‑Clips mit passenden Textbeschreibungen verbinden.[web:3][web:12] Dadurch lernt das Modell, wie sprachliche Hinweise – etwa „Handkamera“, „Zeitlupe“, „goldene Stunde“ oder „cineastischer Stil“ – sich in konkrete visuelle Muster und typische Kamerafahrten übersetzen.[web:3][web:9]

6. Räumlich‑zeitliche Patch‑Analyse

Indem Sora Videos in räumlich‑zeitliche Patches zerlegt, kann es wichtige Bereiche und Zeitabschnitte priorisieren, etwa Gesichter, Körperbewegungen oder Objekte in der Nähe der Kamera.[web:3][web:12] Das hilft, Fokus und Schärfe dort zu halten, wo Zuschauer intuitiv hinsehen, und reduziert Artefakte in weniger relevanten Bildbereichen.[web:2][web:11]

7. Dynamische Modellierung für realistische Bewegung

Die Trainingsziele von Sora 2 legen großen Wert auf physikalisch plausibles Verhalten: Flüssigkeiten, Stoffe oder Schatten verhalten sich deutlich realistischer als in frühen Video‑Modellen.[web:2][web:6] Gleichzeitig kann das Modell auch stilisierte oder surreale Bewegungen erzeugen, wenn dies ausdrücklich im Prompt gefordert wird.[web:3][web:10]

8. Verbesserte Auflösung

In der Praxis beginnen viele Workflows mit einer niedrigeren Repräsentation, die anschließend zu 720p oder 1080p hochskaliert und geschärft wird.[web:7][web:10] Dadurch bleiben Details wie Texturen, Reflexionen und feine Bewegungen auch in kurzen Clips gut erkennbar.[web:10]

Herausragende Funktionen von Sora – dem KI‑Video‑Tool von OpenAI

Sora hat sich seit der ersten öffentlichen Version zu einer vielseitigen Plattform für Creator, Marken und Entwickler entwickelt.[web:2][web:6] Neben der reinen Text‑zu‑Video‑Funktion sind vor allem Qualitätsmerkmale, Geschwindigkeit und Sicherheit entscheidend.[web:3][web:5]

Zusätzlich zur Videoerstellung bietet OpenAI mit DALL·E 3 ein spezialisiertes Modell für „Text‑zu‑Bild“, das sich gut mit Sora kombinieren lässt – etwa indem Standbilder in nachträglich animierte Szenen verwandelt werden.[web:3][web:9]

Hier sind einige zentrale Merkmale von Sora in der aktuellen Generation:[web:2][web:6]

- Moderne KI‑Technologie: Sora nutzt fortgeschrittene Diffusions‑ und Transformer‑Architekturen und liefert kurze Videos mit filmähnlicher Qualität, realistischeren Materialien und stabilerer Bewegung.[web:2][web:10]

- Zugriff und Rollout: Die ersten Versionen waren eng an ChatGPT‑Plus‑ und Pro‑Konten gekoppelt; seit Ende 2025 wird Sora schrittweise über eine eigene Sora‑App und Weboberfläche in weiteren Märkten ausgerollt.[web:3][web:6][web:5]

- Sicherheit: OpenAI versieht Sora‑Videos mit C2PA‑Metadaten und weiteren Signalen, um KI‑Inhalte besser kenntlich zu machen, und arbeitet mit externen Forschern an Schutzmechanismen gegen Deepfakes und Missbrauch.[web:3][web:8][web:14]

- Video‑Personalisierung: Creator können Inhalte für Bildung, Marketing oder Social Media sehr gezielt an Zielgruppen, Markenstil und Format (Hochkant, Querformat, Quadrat) anpassen.[web:7][web:10]

- Vielseitige Stile: Sora unterstützt realistische Szenen, 2D‑ und 3D‑Animation, stilisierte Looks und Mischformen, sodass von Werbeclips bis zu experimentellen Kurzfilmen vieles möglich ist.[web:3][web:10]

- Kreative, nicht‑realistische Szenen: Durch die Kombination physiknahen Verhaltens mit stilisierten Effekten lassen sich auch bewusst „unreale“ Welten und abstrakte Szenen erzeugen.[web:2][web:11]

- Hohe Detailtiefe: Sora 2 legt Wert auf feinere Texturen, lebendige Lichtstimmungen und konsistente Charakterdarstellung über die gesamte Clip‑Länge.[web:2][web:10]

- Bearbeitung bestehender Inhalte: In vielen Interfaces können Nutzer Bilder animieren, Videos verlängern oder Varianten („Remixe“) generieren, ohne jedes Mal bei Null zu beginnen.[web:3][web:9]

- Zusammenarbeit und Integration: Sora lässt sich in professionelle Workflows integrieren, etwa über Cloud‑Plattformen oder den geplanten API‑Zugang, sodass Teams Clips direkt in bestehende Schnitt‑ oder Produktionspipelines einbinden können.[web:2][web:6]

- Flexible Export‑Optionen: Abhängig von Plan und Plattform sind verschiedene Auflösungen und Seitenverhältnisse verfügbar, wobei 1080p und bis zu ca. 20 Sekunden Videolänge derzeit den Standard bilden.[web:7][web:10][web:13]